FG - Künstliche Intelligenz

Die Forschungsgruppe Künstliche Intelligenz dient als zentrale, projektübergreifende Schnittstelle für die systematische Erforschung und praktische Anwendung moderner KI-Methoden. Die Gruppe widmet sich der Erfassung und Bewertung der rasanten Entwicklungen im Bereich des maschinellen Lernens und macht diese für ein breites Spektrum wissenschaftlicher Fragestellungen zugänglich. Ein Schwerpunkt liegt auf der Entwicklung eines gemeinsamen Verständnisses von modernsten Systemarchitekturen und technologischen Trends, um einen Wettbewerbsvorteil in Forschung und Entwicklung zu sichern.

Unsere Arbeit deckt die gesamte Wertschöpfungskette der KI-Entwicklung ab – von der Kuratierung hochwertiger Datensätze über das Training spezialisierter Modelle bis hin zu deren effizientem Einsatz auf leistungsstarker Hardware. Ein wichtiges Ziel ist die Analyse der komplexen Wechselwirkungen zwischen Algorithmen, Recheninfrastruktur und Modellleistung. Durch die Überbrückung der Kluft zwischen theoretischer Informatik und Ingenieurwesen wollen wir komplexe KI-Modelle in zuverlässige Werkzeuge für technische Umgebungen übersetzen.

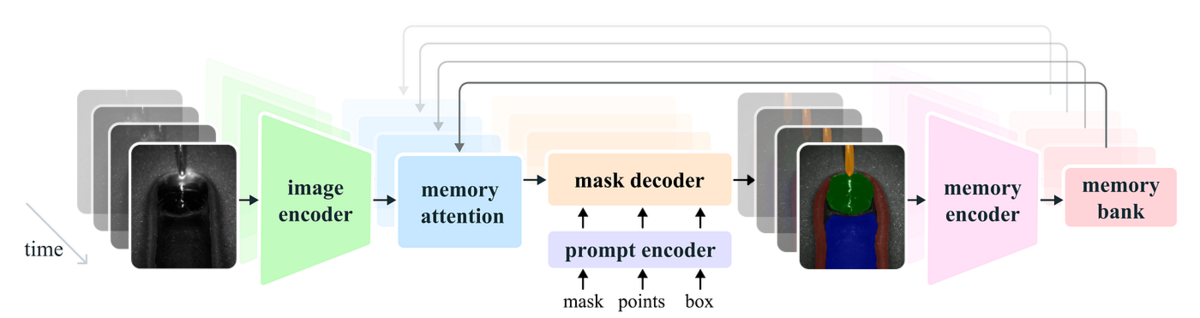

Ein besonderer Schwerpunkt liegt auf der Integration von KI-Methoden in fortschrittliche Produktionstechnologien, insbesondere in die additive Fertigung und die hybride Fertigung. Dabei nutzt die Gruppe KI-Methoden zur Optimierung komplexer Prozessketten, zur Vorhersage von Fehlerentstehungen sowie zur Analyse der Mikrostrukturbildung. Durch die Implementierung von Physics-Informed Neural Networks (PINNs) und die Integration von KI in bestehende Simulationsframeworks (wie CFD und FEM) wollen wir komplexe physikalische und technische Probleme lösen, welche mit traditionellen Methoden allein nicht zu bewältigen sind. Dieser integrierte Ansatz leistet einen wichtigen Beitrag zur digitalen Transformation der Fertigungswissenschaft und zur Entwicklung intelligenter, datengesteuerter Produktionssysteme.

Gruppenmitglieder:

| Karsten Scheibe, Dr. rer. nat. | Gruppenleiter |

| Johann Albers, M.Sc. | Co.-Gruppenleiter |

Angebote:

Themen für Masterarbeiten im Bereich der Entwicklung von KI Modellen mit dem Fokus auf der hybriden Fertigung werden zeitnah veröffentlicht. Bei weiterem bzw. allgemeinen Interesse können Sie sich hier melden.